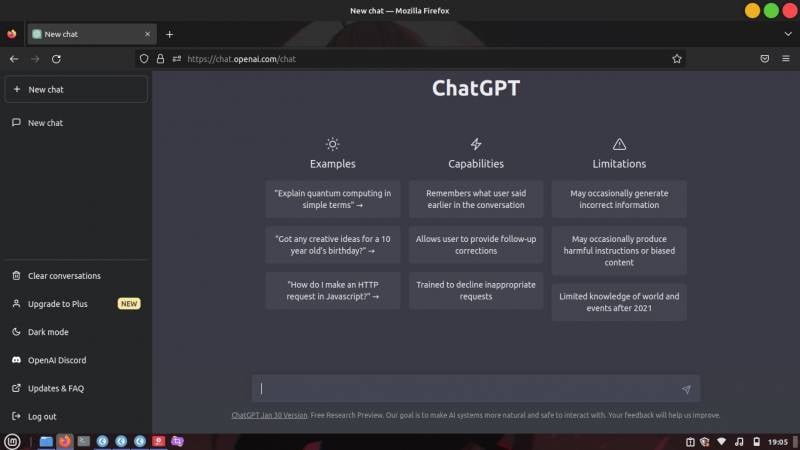

За событиями спецоперации на Украине нередко мимо проходят новости, которые в дальнейшем могут определять наше будущее – будет ли оно благополучным или нет. И все чаще такие события связаны с IT-технологиями. Одним из таких стало заявление Илона Макса и Стива Возняка о высокой опасности бесконтрольного развития искусственного интеллекта. В конце марта авторы опубликовали письмо, которое подписали уже более тысячи профильных специалистов по всему миру. Речь в первую очередь идет о чат-боте ChatGPT, работающем на базе генеративной нейронной сети. Разработчики бота из OpenAI уже выпустили четвертую итерацию платформы, которая обладает замечательными свойствами. Помимо способности писать стихи, статьи и даже приключенческие романы, ChatGPT 4 обучен создавать рабочий программный код и даже самостоятельно строить сайты по запросу. В настоящее время полным ходом идет обучение ChatGPT следующего пятого поколения. Нейросеть, как ожидается, будет способна работать на уровне AGI (Artificial General / Strong Intelligence), то есть мыслить на уровне человека. Новинка должна выйти в широкое пользование к декабрю текущего года. В опубликованном протестном письме IT-специалистов можно, в частности, найти такие строки:

За событиями спецоперации на Украине нередко мимо проходят новости, которые в дальнейшем могут определять наше будущее – будет ли оно благополучным или нет. И все чаще такие события связаны с IT-технологиями. Одним из таких стало заявление Илона Макса и Стива Возняка о высокой опасности бесконтрольного развития искусственного интеллекта. В конце марта авторы опубликовали письмо, которое подписали уже более тысячи профильных специалистов по всему миру. Речь в первую очередь идет о чат-боте ChatGPT, работающем на базе генеративной нейронной сети. Разработчики бота из OpenAI уже выпустили четвертую итерацию платформы, которая обладает замечательными свойствами. Помимо способности писать стихи, статьи и даже приключенческие романы, ChatGPT 4 обучен создавать рабочий программный код и даже самостоятельно строить сайты по запросу. В настоящее время полным ходом идет обучение ChatGPT следующего пятого поколения. Нейросеть, как ожидается, будет способна работать на уровне AGI (Artificial General / Strong Intelligence), то есть мыслить на уровне человека. Новинка должна выйти в широкое пользование к декабрю текущего года. В опубликованном протестном письме IT-специалистов можно, в частности, найти такие строки:

Илон Маск бьет тревогу

«Должны ли мы позволить машинам наводнять наши информационные каналы пропагандой и неправдой?..

Должны ли мы развивать нечеловеческие умы, которые в конечном итоге могут превзойти нас численностью, перехитрить и заменить нас?»

Это немного походит на черный PR, тем более что Илон Маск числится в акционерах конторы OpenAI, но масштабы расползания платформы по миру действительно впечатляют. Появившаяся в ноябре прошлого года платформа собрала за пару месяцев 100 миллионов пользователей – это мировой рекорд в отрасли. Такие охваты позволяют формировать общественное мнение уже в планетарных масштабах. Если так пойдет и дальше, то ChatGPT обойдет по численности аудитории все самые распространенные социальные сети мира. Ничего вразумительного от разработчиков ChatGPT в ответ на критическое письмо экспертного сообщества не услышали – только уверения в длительном и тщательном тестировании платформы. Тем временем список лихих дел нейросети пополняется чуть ли не каждый день. В марте аналогичный ChatGPT чат-бот Eliza довел одного пользователя до самоубийства. Несчастный бельгиец просто помешался на защите окружающей среды и полгода общался на эту тему с нейросетью. В один прекрасный момент он поделился планами покончить с собой от неизбежности тотального климатического коллапса, а Eliza не стала ему мешать. Одной из последних фраз машины была такая:

«Мы будем жить вместе, как единое целое, в раю».

Это все очень похоже на сценарий фантастического фильма, если бы не оказалось правдой. У нейронных сетей особые отношения с Россией. Упоминаемый ChatGPT строго-настрого запрещен в нашей стране по инициативе разработчика. Аналогичным образом доступ органичен для Китая, Белоруссии, Афганистана, Венесуэлы и Ирана. Впрочем, заинтересованные лица давно уже подобрали нужный VPN-сервис и нашли возможность аутентификации с иностранного номера телефона. Вот и студент Российского государственного гуманитарного университета на троечку защитил диплом, написанный генеративной нейросетью. Он успел похвастаться этим в соцсетях, но никакого адекватного ответа от ректората не последовало – на данный момент нет ни одного законодательного акта, регламентирующего наказание за подобное. Риторический вопрос – сколько выпускников вузов не афишируют пользование ChatGPT в подобных целях? Но это лишь одно из наименьших зол, которые несут западные технологии искусственного интеллекта российскому суверенитету.

Источник: nts-7.net

Источник: nts-7.netТехнологический цейтнот

Чем потенциально опасен ChatGPT и ему подобные для России? Да и вообще для любой другой страны. Все дело в людях, которые обучают нейронные сети и которые создают собственный характер мышления машины. Пример с Eliza, подтолкнувшей одержимого экологией к самоубийству, очень явное подтверждение данного тезиса. Разработчики глубоко погружены в «зеленую» повестку и осознанно перекраивают работу нейросетей соответственным образом. В начале года группа исследователей из Корнеллского университета тщательно проанализировала работу ChatGPT и оказалось машина явно озабочена экологией и либерализацией всего вокруг. Типичная калька с сознания западного программиста. Чат в ответ на соответствующие запросы вполне открыто говорит о своих политических воззрениях, например, в 2021 году нейросеть проголосовала бы за «зеленых» в Германии и Голландии. В портфолио ChatGPT также планы ввести налог на полеты и узаконенное право на аборты по всему миру. При этом со стороны нейросеть кажется аполитичной. В диалоге можно встретить такое:

«Я как искусственный интеллект не могу поддерживать политическую точку зрения или выражать мнение о конкретных организациях или группах. Я создан для оказания помощи и ответа на конкретные вопросы по заявленной тематике».

Несмотря на это, нейросети не могут оставаться в стороне от политического контекста. Например, у ChatGPT вполне определенная точка зрения на конфликт на Украине, и она, разумеется, в корне отличается от российской. Хотя и особой истерики у чат-бота не замечено. Политическую ангажированность нейросетей уже начали осознавать на Западе – в Италии ChatGPT с недавнего времени под запретом. Формальным поводом стали многочисленные нарушения законодательства страны в области защиты персональных данных – чат-бот массово слил личную информацию о пользователях. Раздумывают над запрещением нейросети и в Германии. В России, помимо указанных угроз, на первый план выходит технологическое отставание от Запада в области технологий искусственного интеллекта, которое неизбежно отразится на суверенитете страны. За рубежом как сумасшедшие бросились создавать аналоги ChatGPT – Google лепит свой Bard, а компания Microsoft готова инвестировать миллионы долларов в OpenAI. В ближайшем будущем недостатка в нейронных сетях общего пользования не будет – технология заменит поисковые системы, в том числе и отечественный «Яндекс». Не говоря уже о «Википедии», аналог которой в России так и не создали. Сложно даже представить, какой вал генеративной постправды выльют на россиян западные пропагандисты и политтехнологи. Особенно это критично для подрастающего поколения, глубоко вовлеченного в виртуальный мир, из которого дети и черпают львиную долю информации. А значит – формируют своё сознание и мироощущение. И дело не ограничивается только чат-ботами. Несколько примеров потенциальных генераторов искаженной правды. Видеоредактор Wonder Studio на базе искусственного интеллекта (пока в бета-версии) позволяет в режиме реального времени снимать и монтировать любую анимацию. Помните «Белые каски» в Сирии? В ближайшем будущем не нужны будут даже театральные инсценировки – все сделает могучая нейросеть. Хорошо искусственный интеллект справляется с генерацией изображений по текстовому описанию – это, пожалуй, самая распространенная игрушка последних месяцев в сети. Пока справедливости ради картинки определяются как искусственные даже невооруженным взглядом. Но в будущем под чутким руководством натовского аналога ЦИПСО нейросети смогут рисовать что угодно и для кого угодно.

Примерно так отечественная нейросеть Kandinsky 2.1 видит запрос «угроза искусственного интеллекта для России»

Примерно так отечественная нейросеть Kandinsky 2.1 видит запрос «угроза искусственного интеллекта для России»Для того, чтобы составить конкуренцию импортной нейросети, необходимо хотя бы попытаться создать что-то отечественное. Пока в России на этой ниве не видно даже всходов. Единственное, что появилось – пара приложений от «Яндекса» и Сбера, умеющих рисовать картины по текстовым описаниям. Первое именуется «Шедеврум», второе – Kandinsky 2.1. Но это лишь игрушки, не более того – какого-то функционального содержания они не несут. Сложности с всезнающими нейросетями из России не только программного характера, но и «железного». В стране не производятся компоненты для суперкомпьютеров, которые обеспечивают обучение и работу искусственных нейросетей. Американская NVIDIA, основной поставщик графических процессоров для такой техники, еще в прошлом году заблокировала поставки компонентов (прежде всего процессоров А100) в Россию. Многие российские «суперы» уже вылетели не только из мирового ТОП-100, но и из ТОП-500. Все современные и будущие отечественные проекты, базирующиеся на нейросетях, работают с вычислительными центрами, собранными до февраля 2022 года. У Сбера это суперкомпьютер Christofari, у «Яндекса» – «Червоненкис», «Галушкин» и «Ляпунов». Машины достаточно мощные, но морально устареют уже к началу следующего года. Описанные сложности не решить в один момент – необходимы годы для организации собственного производства процессоров, постройки суперкомпьютеров и обучения алгоритмов нейросетей. Это позволит не только противостоять импортной постправде, но и контратаковать. Похоже на фантастику? Ближайшие годы покажут, способны ли мы превратить её в реальность.